Contenu connexe

Similaire à Proxmox VE 4.3 vs VMWare vSphere 6.1 (20)

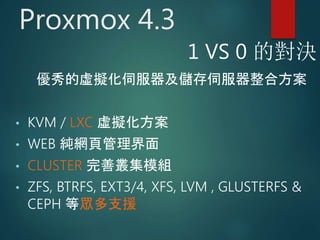

Proxmox VE 4.3 vs VMWare vSphere 6.1

- 2. Proxmox 4.3 VS

標準檔案格式系統,支援多種 FS

開放式硬體式支援,兼容性高

免費使用,企業更新年費制*

支援 KVM & LXC (container)

網頁,CLI & 手機界面管理

Scale Out 架構

原廠封閉檔案格式 VMFS

封閉式硬體支援,兼容性低

付費授權制 per Core

支援VM,有限的支援 container

CLI, Flash GUI 管理

Scale Up 架構

VMWare vSphere 6.1

- 9. PVE Storage 的選擇 - ZFS

ZFS 適合 2~21台的 node 配置

一般小型企業到中型企業都合適

4到8顆 HD (RAID 1+0), 1 到 2 顆 SSD

1 gbe ~10 gbe 網路

擁有完整快照功能, 其 zsync, auto

snapshot 已經內建, Clone 非常方便 跟

kvm clone 不同

- 10. PVE Storage 的選擇 - CEPH

CEPH 適合 7 node 以上的配置, 建議超過

21 node 以上時 它的效能就會展現出來

適合線上遊戲, 電商或是入門網站 & 大數

據分析

建議 AFA, NVMe Only

10gbe~100gbe 網路 區分client & server

需要找專業人員幫忙計算 OSD 參數

無需任何備份* 掉 node 無效能損失

- 11. PVE 建議硬體 – 一般企業

4C8T CPU 以上支援 VT-X AES-NI

16 GB RAM 以上

RAID Card in IT Mode, 或是

主板上的 HBA

Sata 硬碟就可以

4個 1 gbe 以上的網卡,

單 Node 或 多 Node 高低配

- 13. PVE 建議硬體 – 中型企業

8C16T CPU: VT-X, VT-D, AES-NI & AVX2

64 GB RAM 以上

RAID卡 in IT Mode, PCIe 的 HBA 卡

企業的 SATA 硬碟 SAS 會更好.

如果可以使用 NVMe SSD Cache 會更好

Dual 10 gbe SR-IOV 功能的網卡 * RDMA

Quad 1 gbe SR-IOV 功能的網卡

3 Nodes 以上 可高低配

- 15. PVE 建議硬體 – 大型企業

8C16T CPU: VT-X, VT-D, AES-NI & AVX2

128 GB RAM 以上

SAS RAID卡 in IT Mode, PCIe 的 SAS HBA 卡

企業 SAS 硬碟 或 AFA會更好.

使用 NVMe SSD Cache.

Dual 40 gbe SR-IOV & RDMA 功能的網卡

Infiniband

Quad 1 gbe SR-IOV 功能的網卡

14 Nodes 以上 可高低配

- 22. Proxmox 4.3 VS AWS EC2

是方 (私有雲) AWS EC2 (公有雲)

每月費用 NT$ 35,000 NT$ 70,000

vCPU數 116 22

HDD容量 60 TB ( 120 TB RAW)8 TB

SSD 容量 1.6 TB 300 GB

總 RAM 896 GB 80 GB

VM 運行數 116 4

LXC 運行數 580 0

頻寬 110 mbps

總流量不限制

1000 mbps

總流量為 100 GB

備份模式 無限制 5次快照,異地備份另計

VPN 以包含 以每分鐘計算

Notes de l'éditeur

- Proxmox PVE 是使用 Debian Jessie

[click]

kernel 是 Ubuntu 十六點零四. 更新速度快 以及 支援更多新的硬體.

比 Redhat/Centos/FreeBSD 快了一年以上.

[click]

這點很重要, 買了新的硬體, 但是如 OS 不支援,

硬體都開始折舊折 然後還不能使用.

企業是不能接受的喲 .

還是企業要購買 舊的硬體? 接近 End of Life 的產品?

[click]

PVE 完美支援 NVMe SSD, 它也完美支援 Mellanox

四十到一百 gigabit 網卡. FreeBSD 比較慢支援的原因為了穩定性.

由於 PVE 支援這些高端硬體,

它可以建立一個 Super Computing Grid 的架構.

[click]

同時它也能支援十年前的 PC, 再陽春的設備也可以,

很多時候都會碰到魚跟熊掌不可以兼得.

但是在 PVE 的世界, 是可以 -大小- 男女老少 - 都能通吃.

[click]

PVE 是 Bare Metal Solution, 是極輕量的虛擬化平台

跟 VMWare vSphere 一樣, 但是它所需要使用的資源更加的少.

同時也整合好了 Software Define Storage 的儲存系統

建制費用更便宜

是自由以及開放的系統, 支援非常多的檔案格式

- 簡單的比較一下 PVE 跟 vSphere�[click]

[click]

VMFS 增加了備份的困難以及其備份機制的價格.

NFS 效能是很“基本的”, 所以略過.

VMWare 的 Hardware Compatible List HCL 存在許多問題

Realtek 的網卡不支援,

舊版的 intel 網卡這次 六點零 也不支援

vCenter 授權很貴族, 才有 vMotion 功能.

又需要 一台 window server 的授權來管理. 其實很肥大

Flash 的管理界面真的很慢, 沒有效率

vSAN vHorizon 的授權實在嚇死寶寶了

現在雲的時代 等於 OpenStack

VMWare 實際在 OpenStack 運行困難重重

vSan 問題司 有 KVM 或 Hyper V 的 VM 可以使用 vSAN 嗎?

在 VMWare NSX 跟 Openstack neutron vlan bridging 我試了很多次,

都還是有很多問題, 就是要全面使用 NSX gateway, 然後其它的統統不能用

表面上可以跟 OpenStack 接軌, 實際上 網絡 跟 儲存 並不是那麼相容.

目前要讓 VMWare 的 vm 直接拋到公有雲是有難度的,

直到 10/13 VMWare 才剛剛宣布跟 Amzon 結盟,準備開始讓 vSphere 跟公有雲接軌. 不過都還是未來式.

而且新的工具, 新的服務, 那麼 vmware 又要準備多收一筆授權費了.

Scale out 的架構, 一定要可以高低配. 舊的版本個舊硬體, 新的版本

跟新硬體 要可以混搭的.

vSphere五的 vHardware 是 v八 版本,

vSphere六的 vHardware 是 v 十一版本

也就是 vSphere 六 的 VM是無法 vMotion 到 vSphere 五 的.

因為 HCL 不同, vSphere五 的伺服器不見得可以升級到 vSphere六.

舊的升不上來, 難道要新的降下去? [一臉驚訝]

.

[笑]

在 PVE 的世界, 是完全沒有這個問題.

- 簡單,

乾淨整齊.

HTML 5

- 一目了然,

速度快,

[比食指]

非 flash 界面.

- 其它 虛擬化平台 缺乏的 管理界面 手機上也行控管

- Live Migration 的功能,跟 vmotion 一樣,

只要有 share storage 就可以做到.

[click play]

在這邊我開啟一個 windows 10 VM 然後開始播放

youtube 的 Live 新聞台

先從 第二個 Node 開始 把一個 vm migrate

到第一個 node 上面

當 migration 開始時, PVE 就開始把 VM 的 RAM 從開始從

B 往上面 A 傳送. 就像是電腦進行休眠模式把記憶體

儲存到硬碟裡. 所以網路速度更快, 那麼 Migration 就越快.

[pause]

有很多展示使用 ping 來顯示 Migration, 但是使用 live stream video 播放,

讓大家第一手感覺在 vm 上面的使用者, 到底會感受到什麼差異

現在 vm 一二零 還在 Node B 下面, 等一下會就跳到 Node A 上面,

但是 RDP 的連線不會斷,

播放中的 streaming video 也不會斷

.

猜猜看 這個 live migration 是使用怎麼樣的等級的機器完成的?

[頓3秒]

主機是 Intel i五 跟 十六 GB 的記憶體. 等一下也可以現場展示

- VDI 建制也一直是企業非常需求的部分. 這邊展示如何利用 PVE 跟 ZFS 的搭配,

迅速建制五個的 獨立檔案系統

windows 十的 VM

[play]

這是我在3分鐘內寫的一個簡易 script

填入 vmid, 然後告知要複製的 hdd 位置

就馬上看到 增加了 122~126 這5個 vm.

.

最棒的一點是, 儲存空間不會因此而暴增.

再來看看每一個 vm 硬碟使用多少空間 ? 才 8K

.

接下來去看每一個 vm,

都是擁有自己的獨立硬碟

也不會關機後資料就不見

.

但是設定的 mac address 要更換一下, 我的 script 偷懶沒有寫入自動增加新的 mac

.

[等5秒]

.

然後就可以開機了, 來開四個 vm 好了

.

當 vm 開啟後, 我們可以看到 console 的開機畫面, 這個已經開啟了, 接下來的也可以看到 windows 十

.

再來這個 demo video 也是 Intel i五 跟 十六 GB 的記憶體.

其實它是 一台 Qnap TVS 八七一 T 操作系統是 PVE 就對了 等等可以到攤位參觀.

- PVE 四點三 訓練費用可能不便宜. 因為自己的時間無價

因為學校沒有教. 所以只能自學,

但是硬體可以使用舊的 pc 或是淘汰的伺服器來測試建制

需要的是, 投資你的時間

任何硬體

[click]

[click]

[click]

通通沒有問題, 這些是 VMWare 做不到的

[2秒]

已經有太多成功的案例, 台灣的教育界,

是台灣之光 在 PVE 社團裡的國小, 國中老師

或資訊組長都是 Pro 等級

.

[看現場反應]

小弟今年才 18歲, 還是在校生,

所以跟國小老師跟國中老師們都混得很熟.

- PVE 是一個 Software Define Computing 的產品,

現在都開始必須要跟 Software Define Storage 以及 Software Define Network 去結合了.

所以一個完整的虛擬化方案, 這兩部分一定不能缺席

在這邊介紹一下 PVE 可以搭配, 我認為最有效能以及潛力的儲存方式.

關於 EXT四 , LVM 傳統格式, 的基本功能, 這邊就略過.

PVE 的 ZFS 支援非常完整, ZFS on Linux 已經非常成熟, 效能也非常的好,

而且它是可以跟 freebsd, nexenta, openindia 的 zfs pool 互相通用的.

- ZFS 跟 Ceph 有太多細部的教學, 這部分有點學無止境, Ceph 在台灣 FB 的論壇, 有高手

Ceph 還是需要專業人士維護的. 當它報錯, 或是其中一個 node 下線時, 還是要修復那個 node 讓它上線的. 不然 node 全部掉光光資料還是會損毀

Ceph 是可以備份的, 它有 remote replica 的功能.

這是我目前特別積極在測試的部分.

- 伺服器之間串聯網路的效能非常重要.

我建制過很多系統架構, 最常碰到的瓶頸

都是網卡速度或是 iops 不夠,

非常少碰到是 cpu 不給力或是 ram 不足的問題.

現在 pc 伺服器 大部分都是運算效能過多,

記憶體過多, 所以我們才虛擬化, 讓一台實體主機跑多台虛擬機.

.

在虛擬化的過程中, 其實是非常需要 CPU 的 “硬解” 來提供加速的.

要有 VT-X 才能開啟 VM, AES dash NI 是重要的加密 Instruction Set

- IT Mode就是 把 RAID 卡刷成 HBA 卡

建議少使用 主板上的 hba, 因為使用 pcie 卡, 如果壞掉了, 可以迅速更換. 同時暫時也可以使用 主板上的 hba. 這是前輩給我的教導. 謝謝 威傑科技! 謝謝王大哥.

盡量使用 SAS 硬碟如果許可的話

如果有 NVMe SSD 來做 Cache 真的會讓寫入效能暴增

SR-IOV 當作是硬體式的虛擬網卡, 也只有 透過 SR-IOV 的模式, 才能讓 VM 或是 LXC 使用到“真正” 的10 gpbs. OV Switch 或是 Linux Bridge 從虛擬機傳送封包 到 實體的 switch 效能只有 七 gigabits 左右. 因為 上述這兩個 SDN 受到 cpu 的限制, 沒有辦法在一秒內處理那麼多的封包. 畢竟 cpu 不適合拿來當 switch 的晶片

- Infiniband

所有 Ethernet 的缺點它都~沒有.

沒有 packet loss

沒有 packet out of sequence 的問題

jumbo frame 六十五個 mega byte 而不是 tcp ip 一千五 MTU 那麼小.

它的 latency 非常的低, 比 Ethernet 低了 10倍以上, 也就是如果 Eehernet ping time 是 零點一 millisecond,

那麼 infiniband 的 ping time 就是 零點零零一 millisecond.

當你在 scale out 做 cluster 的時候, node 之間的快速回應就變成它真正效能的重點,

單一 node 的 cpu 再快, 沒有夠快速的大封包 數據進來給它運算, 那麼 cpu 運算效能就是浪費了

RDMA 是 by pass 其它伺服器上的 cpu, 就可以直接讀取或是寫入 數據 到其它伺服器的 RAM 或是 Storage 裡

在 十 gigabits RDMA Infiniband 的網路, data 的 io, 可以比 10 gigabits Ethernet 的 快上 4 倍. 這個就是為什麼我捨棄 iSCSI.

- 上面是 infiniband 的 ping time

下面是 Ethernet 的 ping time

Latency 是差異很多

- Infiniband 四十 gigabit 的網路

[click]

現在的建制成本不到台幣 10萬元

到我的攤位我會說明

- [click]

開機 1 秒 但是 vm 要 45秒以上

[click]

RAM 只要 50 MB

[click]

Yahoo Japan 的記錄是 90秒內開啟 200萬個 container, 但是相同的時間 vm 只能開 20萬個.

輕量化的 Container 可以大幅增加 企業伺服器的運算能力, 這個就是為什麼 大數據 以及 internet of things 都希望使用 container 來做運算跟分析. 因為資料太龐大太多, 使用 vm 實在太過於肥胖. 這點就是 vmware 的弱項..

[click]

國家的競爭能力已經包含了其超級電腦的運算能力. 以前大家看一家公司只會看其管理階層的能力, 以及財務報表的 EPS. 未來一家公司的軟實力, 一定會包含其 IT 運算能力以及分析能力. 現在 Google 的 人工智慧/深度學習 嚇死很多 S and P 五百 的公司.

特別是 Toyota, 福特, 賓士, 寶馬, 這些汽車大廠, 它們覺得自己已經是風中殘燭, 隨時都會被 Google 的無人車給淘汰.

運算能力以及分析能力是讓企業不要走遠路, 避免錯誤, 及時發現浪費的資源以及可能發生的問題.

沒有看到這一點的企業, 一定會有問題.

像是以前流通業認為通路為王, 但是在電商的時代, 通路真的是王道嗎? Amazon 打死多少美國傳統通路?

淘寶在中國, 擊敗多少實體店面以及百貨公司?

- LXC 隨便我開, 愛怎麼測就怎麼測, 想用什麼 library 什麼環境都隨我, 自由度一百 效率一百 不用等 system admin 開給我

- 我的工作站就是我的 PVE 要 x-window 也行!

- 自建的私有雲, 有以下的優點

有更多的儲存空間

備份模式更加自由

增添需要新的IT服務不會增加費用

使用移動用戶 VPN 專線聯入私有雲不需要特別的費用, 但是 AWS 日本的 vpn 服務是以每分鐘計費

這個表的比較, 你可以看到價格是一半, 但是運算是5倍多, 容量是 7倍多, 最重要的 vpn 在公有雲上面是記時記量的

- 有Proxmox 4.3 就不需要公有雲?

[click]

公有雲有絕對的必要性! 但是比例分配只能 二比八. 核心服務不要上公有雲.

[click]

假設我司有一個大型促銷, 參加淘寶的光棍節網路大促銷,

預期為兩個禮拜的時間, 會跟我司交易/庫存系統結合資料的部分

比平時暴增 10倍~20倍.

而我司的硬體服務架構無法快速擴充,

同時如果事先3個月建制, 只是為了這兩個禮拜的服務, 需要每月折舊攤提設備,

但平時都是閒置 90%, 昂貴的折舊攤提也是不符合 ROI 效益

所以使用公有雲的 on demand service 就非常符合經濟效益.

圖表是企業什麼時候需要短暫使用公有雲的服務, 綠色虛線以上時.

- Proxmox 4.3 目的不是要省錢

Proxmox 4.3 目的不是要省錢

[click]

Proxmox 4.3 目的不是要省錢

[click]

而是集中資源資金增加企業的運算以及分析能力, 進而達到產業提升.

- 光華的黨贏 陳大哥

Interface Virtual 外借的機器

以及 PCTine 隨時的收集資料跟督促

- 謝謝 Jason 的修飾

希望等下抽大獎時可以看到他的名片

- 此次測試設備的 HDD

都是 ZFS & Seagate Enterprise NAS HDD