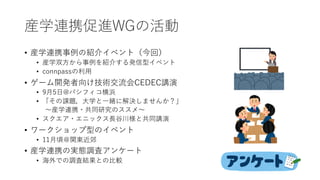

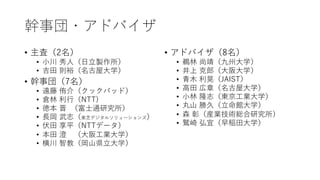

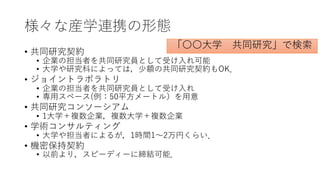

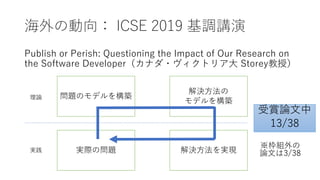

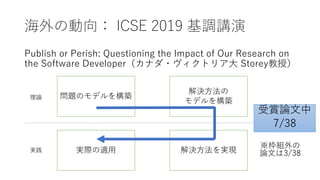

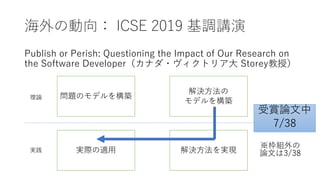

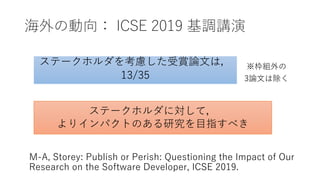

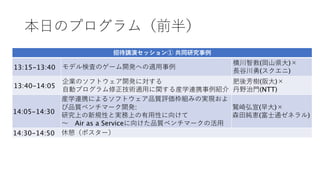

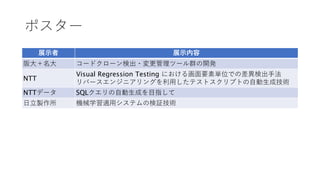

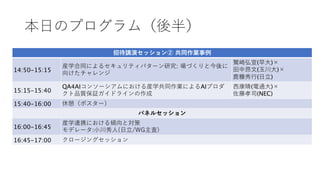

Le document semble être un horaire ou un programme d'événements, mentionnant des sessions spécifiques avec des plages horaires. Il couvre des sujets tels que l'IA, le test de régression visuel et d'autres thèmes technologiques. Les détails précis sur les intervenants et les sessions ne sont pas clairement lisibles.