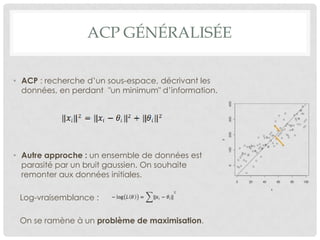

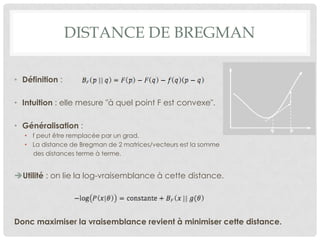

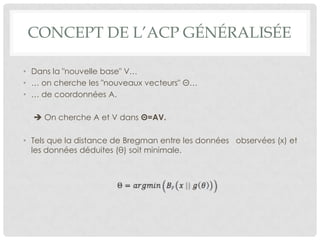

Le document traite de l'extension de l'analyse en composantes principales (ACP) pour gérer des données affectées par des bruits non gaussiens, en généralisaant l'ACP classique avec des distances de Bregman. Cela permet de traiter divers types de distributions, notamment celles appartenant à la famille exponentielle, tout en maintenant un lien avec la maximisation de la log-vraisemblance. Un algorithme est proposé pour estimer les nouveaux vecteurs et leurs coordonnées dans une nouvelle base, optimisant ainsi la distance entre les données observées et les données déduites.