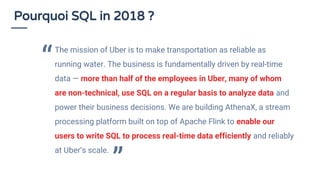

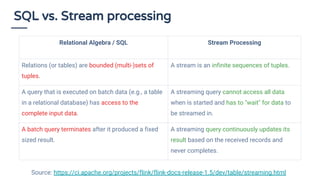

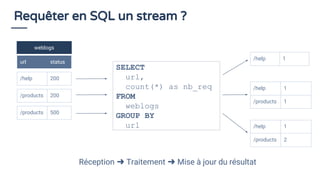

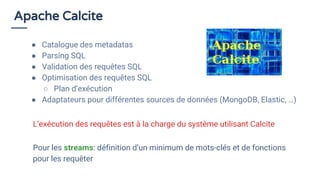

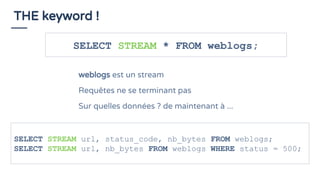

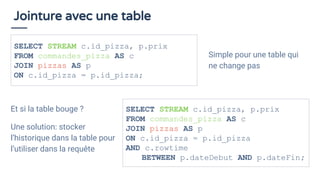

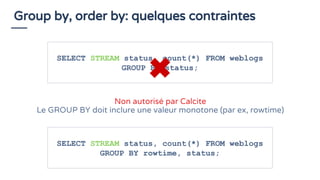

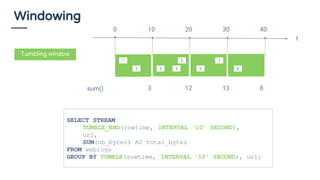

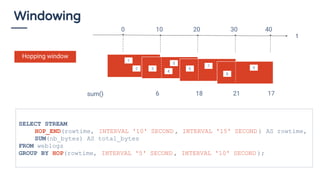

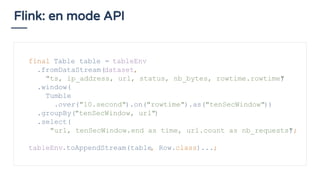

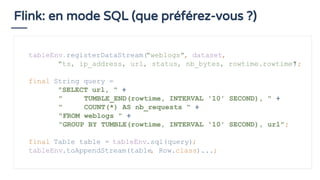

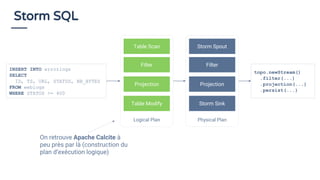

La présentation de Bruno Bonnin aborde l'utilisation de SQL dans le traitement de flux de données en temps réel, soulignant son importance en tant que standard accessible même aux non-techniciens, comme ceux d'Uber. Il explique les différences clés entre le traitement par lots et le traitement en continu, tout en présentant des exemples pratiques de requêtes SQL sur des flux de données à l'aide de la plateforme de traitement de flux Apache Flink. Enfin, il met en avant les capacités d'Apache Calcite pour optimiser et exécuter des requêtes SQL sur des données en streaming, illustrant ainsi la convergence entre le traitement de flux et SQL.