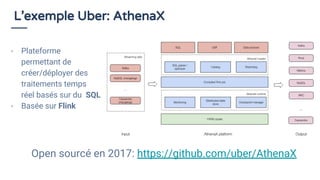

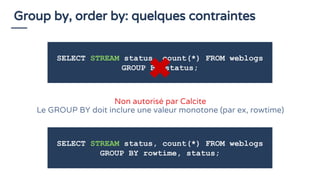

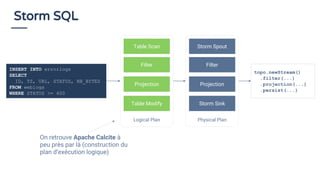

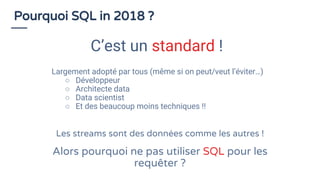

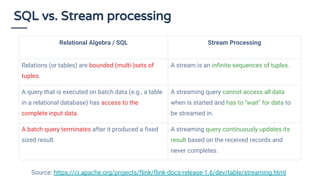

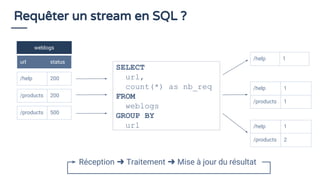

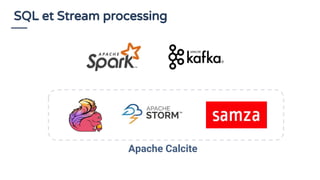

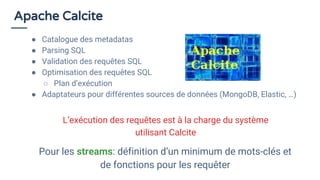

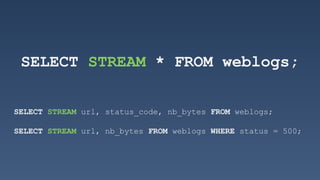

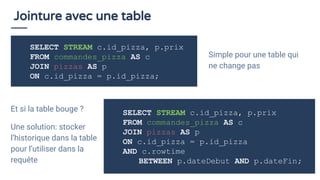

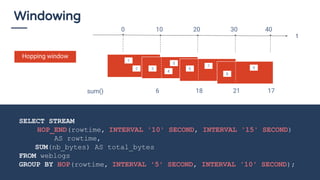

Le document traite du traitement de flux de données et de l'utilisation du SQL en 2018 pour interroger ces flux, en soulignant que le SQL reste un standard précieux. Il explore des concepts tels que la définition de fenêtres de temps et l'utilisation d'Apache Calcite pour optimiser les requêtes SQL sur des flux de données. En conclusion, il est anticipé qu'une majorité d'organisations adopteront le streaming de données pour des analyses en temps réel d'ici 2020, mettant en avant l'importance d'une approche accessible pour tous les acteurs impliqués.

...

execEnv.execute()](https://image.slidesharecdn.com/streamprocessingetsql-181030171404/85/Stream-processing-et-SQL-14-320.jpg)

...

execEnv.execute()](https://image.slidesharecdn.com/streamprocessingetsql-181030171404/85/Stream-processing-et-SQL-15-320.jpg)