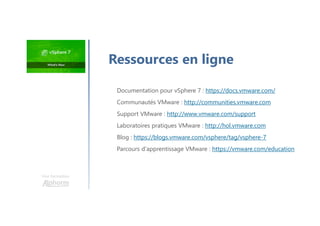

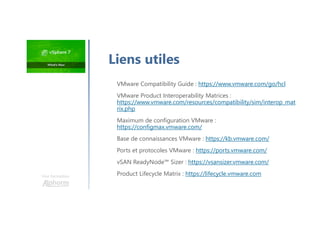

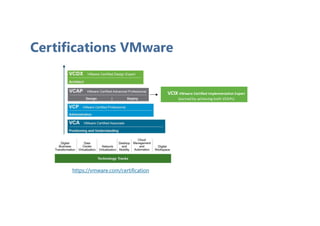

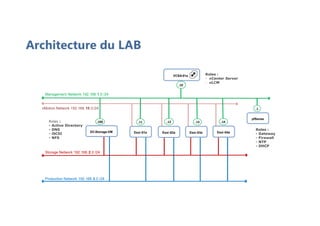

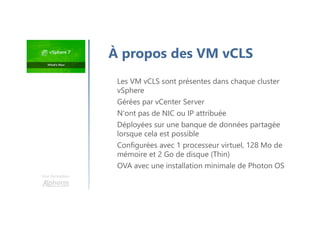

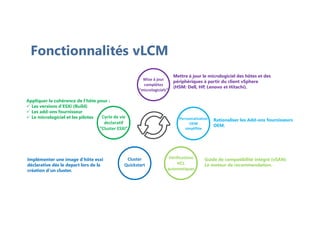

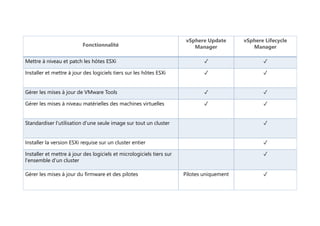

La formation d'Alaa El Bejjaj sur VMware vSphere 7 se concentre sur les nouvelles fonctionnalités, y compris les améliorations de stockage, de sécurité et de gestion de cycle de vie. Elle s'adresse aux administrateurs et ingénieurs souhaitant mettre à jour leurs connaissances et se préparer à la certification VCP-DCV 2021. Des ressources en ligne et des laboratoires pratiques sont également fournis pour compléter l'apprentissage.