Le document traite de la planification et de l'analyse d'expériences numériques en adoptant une approche bayésienne, en mettant particulièrement l'accent sur l'optimisation séquentielle. Il présente des exemples concrets, tels que l'optimisation de forme dans le secteur automobile et l'analyse de risques en sûreté nucléaire, pour illustrer l'application des méta-modèles et des simulations bayésiennes. Enfin, une discussion sur les compromis entre exploration et exploitation dans le cadre d'expériences numériques est incluse.

![Compromis exploration/exploitation

Deux stratégies « extrêmes »

1

0.9

remplir au mieux le domaine X

0.8

0.7

essayer d’aller droit au but

0.5

0.4

0.3

0.2

0.1

choisir un bon x1 ∈ X (connaissance a priori)

optimiser localement, par ex. Nelder-Mead

Julien Bect (SUPELEC)

0.6

yy

ex : X = [0; 1], xi = 2i−1 , 1 ≤ i ≤ N

2N

échantillonages LHS, maximin, . . . (si d ≥ 2)

Computer experiments

0

0

0.1

0.2

0.3

0.4

0.5

xx

0.6

0.7

0.8

0.9

1

Séminaire ONERA/DSNA 28 novembre 2

/ 24](https://image.slidesharecdn.com/jbect-onera-dsna-2013-11-28-131203070450-phpapp01/85/Planification-et-analyse-d-experiences-numeriques-approche-bayesienne-21-320.jpg)

![Compromis exploration/exploitation

Deux stratégies « extrêmes »

1

0.9

remplir au mieux le domaine X

0.8

0.7

essayer d’aller droit au but

0.6

yy

ex : X = [0; 1], xi = 2i−1 , 1 ≤ i ≤ N

2N

échantillonages LHS, maximin, . . . (si d ≥ 2)

0.5

0.4

0.3

0.2

0.1

choisir un bon x1 ∈ X (connaissance a priori)

optimiser localement, par ex. Nelder-Mead

0

0

0.1

0.2

0.3

0.4

0.5

xx

0.6

0.7

0.8

0.9

1

Principe fondamental

bien optimiser globalement ⇒

chercher un compromis entre

exploration et exploitation

Explorer tout le domaine, oui, mais pas uniformément !

Julien Bect (SUPELEC)

Computer experiments

Séminaire ONERA/DSNA 28 novembre 2

/ 24](https://image.slidesharecdn.com/jbect-onera-dsna-2013-11-28-131203070450-phpapp01/85/Planification-et-analyse-d-experiences-numeriques-approche-bayesienne-22-320.jpg)

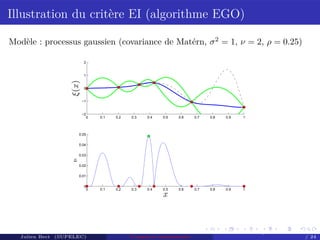

![Illustration : usage optimiste du méta-modèle

Exemple avec X = [0; 1], méta-modèle : krigeage.

n = n0 = 4

2

1.5

1

ξ(x)

0.5

0

−0.5

−1

−1.5

−2

0

Julien Bect (SUPELEC)

0.1

0.2

0.3

0.4

0.5

x

0.6

Computer experiments

0.7

0.8

0.9

1

Séminaire ONERA/DSNA 28 novembre 2

/ 24](https://image.slidesharecdn.com/jbect-onera-dsna-2013-11-28-131203070450-phpapp01/85/Planification-et-analyse-d-experiences-numeriques-approche-bayesienne-24-320.jpg)

![Illustration : usage optimiste du méta-modèle

Exemple avec X = [0; 1], méta-modèle : krigeage.

n = n0 = 4

2

1.5

1

ξ(x)

0.5

0

−0.5

−1

−1.5

−2

0

Julien Bect (SUPELEC)

0.1

0.2

0.3

0.4

0.5

x

0.6

Computer experiments

0.7

0.8

0.9

1

Séminaire ONERA/DSNA 28 novembre 2

/ 24](https://image.slidesharecdn.com/jbect-onera-dsna-2013-11-28-131203070450-phpapp01/85/Planification-et-analyse-d-experiences-numeriques-approche-bayesienne-25-320.jpg)

![Illustration : usage optimiste du méta-modèle

Exemple avec X = [0; 1], méta-modèle : krigeage.

n=5

2

1.5

1

ξ(x)

0.5

0

−0.5

−1

−1.5

−2

0

Julien Bect (SUPELEC)

0.1

0.2

0.3

0.4

0.5

x

0.6

Computer experiments

0.7

0.8

0.9

1

Séminaire ONERA/DSNA 28 novembre 2

/ 24](https://image.slidesharecdn.com/jbect-onera-dsna-2013-11-28-131203070450-phpapp01/85/Planification-et-analyse-d-experiences-numeriques-approche-bayesienne-26-320.jpg)

![Illustration : usage optimiste du méta-modèle

Exemple avec X = [0; 1], méta-modèle : krigeage.

n=6

2

1.5

1

ξ(x)

0.5

0

−0.5

−1

−1.5

−2

0

Julien Bect (SUPELEC)

0.1

0.2

0.3

0.4

0.5

x

0.6

Computer experiments

0.7

0.8

0.9

1

Séminaire ONERA/DSNA 28 novembre 2

/ 24](https://image.slidesharecdn.com/jbect-onera-dsna-2013-11-28-131203070450-phpapp01/85/Planification-et-analyse-d-experiences-numeriques-approche-bayesienne-27-320.jpg)

![Illustration : usage optimiste du méta-modèle

Exemple avec X = [0; 1], méta-modèle : krigeage.

n=7

2

1.5

1

ξ(x)

0.5

0

−0.5

−1

−1.5

−2

0

Julien Bect (SUPELEC)

0.1

0.2

0.3

0.4

0.5

x

0.6

Computer experiments

0.7

0.8

0.9

1

Séminaire ONERA/DSNA 28 novembre 2

/ 24](https://image.slidesharecdn.com/jbect-onera-dsna-2013-11-28-131203070450-phpapp01/85/Planification-et-analyse-d-experiences-numeriques-approche-bayesienne-28-320.jpg)

![Illustration : usage optimiste du méta-modèle

Exemple avec X = [0; 1], méta-modèle : krigeage.

n=8

2

1.5

1

ξ(x)

0.5

0

−0.5

−1

−1.5

−2

0

Julien Bect (SUPELEC)

0.1

0.2

0.3

0.4

0.5

x

0.6

Computer experiments

0.7

0.8

0.9

1

Séminaire ONERA/DSNA 28 novembre 2

/ 24](https://image.slidesharecdn.com/jbect-onera-dsna-2013-11-28-131203070450-phpapp01/85/Planification-et-analyse-d-experiences-numeriques-approche-bayesienne-29-320.jpg)

![Illustration : usage optimiste du méta-modèle

Exemple avec X = [0; 1], méta-modèle : krigeage.

n=9

2

1.5

1

ξ(x)

0.5

0

−0.5

−1

−1.5

−2

0

Julien Bect (SUPELEC)

0.1

0.2

0.3

0.4

0.5

x

0.6

Computer experiments

0.7

0.8

0.9

1

Séminaire ONERA/DSNA 28 novembre 2

/ 24](https://image.slidesharecdn.com/jbect-onera-dsna-2013-11-28-131203070450-phpapp01/85/Planification-et-analyse-d-experiences-numeriques-approche-bayesienne-30-320.jpg)

![Illustration : usage optimiste du méta-modèle

Exemple avec X = [0; 1], méta-modèle : krigeage.

n = 10

2

1.5

1

ξ(x)

0.5

0

−0.5

−1

−1.5

−2

0

Julien Bect (SUPELEC)

0.1

0.2

0.3

0.4

0.5

x

0.6

Computer experiments

0.7

0.8

0.9

1

Séminaire ONERA/DSNA 28 novembre 2

/ 24](https://image.slidesharecdn.com/jbect-onera-dsna-2013-11-28-131203070450-phpapp01/85/Planification-et-analyse-d-experiences-numeriques-approche-bayesienne-31-320.jpg)

![Illustration : usage optimiste du méta-modèle

Exemple avec X = [0; 1], méta-modèle : krigeage.

n = 11

2

1.5

1

ξ(x)

0.5

0

−0.5

−1

−1.5

−2

0

0.1

0.2

0.3

0.4

0.5

0.6

0.7

0.8

0.9

x

Convergence vers un maximum local !

Julien Bect (SUPELEC)

Computer experiments

1

Séminaire ONERA/DSNA 28 novembre 2

/ 24](https://image.slidesharecdn.com/jbect-onera-dsna-2013-11-28-131203070450-phpapp01/85/Planification-et-analyse-d-experiences-numeriques-approche-bayesienne-32-320.jpg)