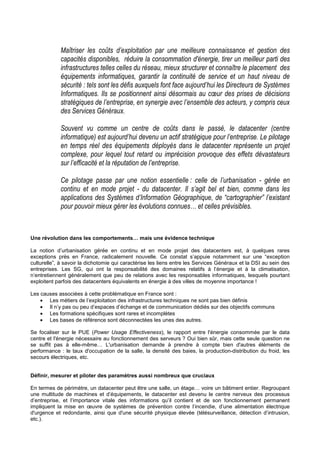

Le document aborde la gestion et la résilience des datacenters, soulignant l'importance d'une gestion efficace des capacités pour maîtriser les coûts et l'énergie. Il propose une solution, Datacenter One, qui facilite l'urbanisation et la cartographie des composants des datacenters, tout en répondant aux besoins des directeurs de systèmes informatiques. L'accent est mis sur la collaboration entre diverses parties prenantes pour optimiser les performances et assurer la continuité des services.