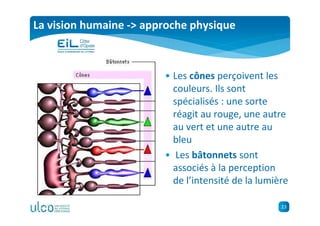

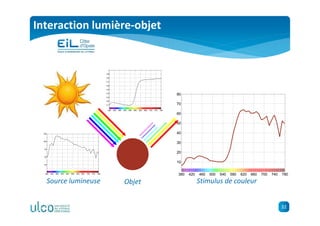

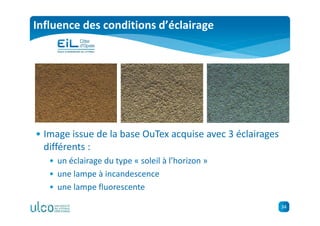

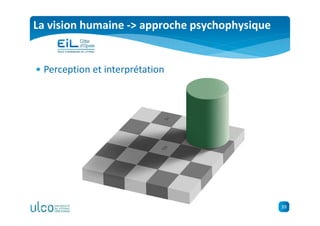

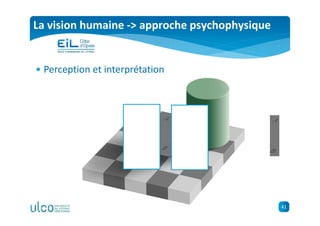

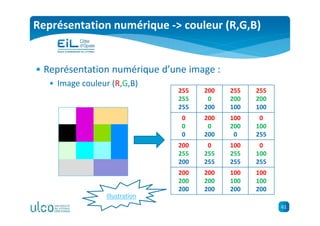

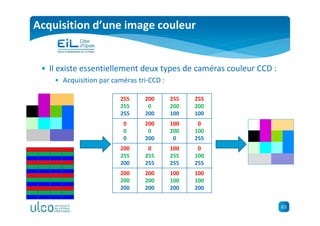

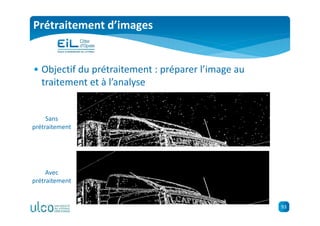

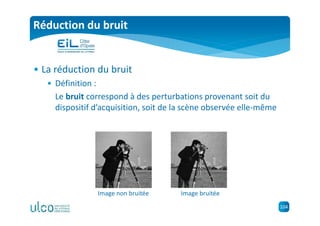

Le document traite du traitement d'images et de la vision, abordant des concepts tels que la perception visuelle humaine, les outils de traitement d'images et les types de traitement. Il se divise en plusieurs sections, expliquant des techniques de prétraitement, segmentation, analyse et classification d'images, ainsi que l'importance de la vision par ordinateur pour automatiser des tâches. L'approche physique et psychophysique de la perception visuelle est également expliquée, mettant en lumière les interactions entre lumière, objets et perception.

![98

Expansion de dynamique

• Expansion de dynamique

• Objectif : utiliser au mieux l’échelle de niveaux de gris

disponible

• Améliore le contraste

• Transformation linéaire des niveaux de gris

• Utilisation d’une table de conversion -> LUT (Look Up Table) :

Soit N, le niveau de quantification (en général N=256) :

n ∈ [nmin; nmax ] -> n’ ∈ [0; 255]

−

−

−Ε=

minmax

min )(

)1('

nn

nn

Nn )()'( nHnH =](https://image.slidesharecdn.com/visionettraitementdimages-190104074823/85/Vision-et-traitement-d-images-98-320.jpg)

![147

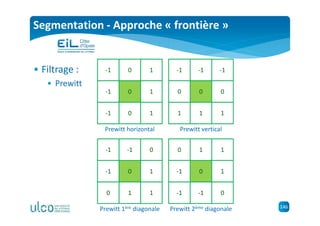

Segmentation - Approche « frontière »

• Filtrage :

• Roberts

• Application de 2 masques :

• Roberts[x][y] = abs(I[x][y]-I[x+1][y+1]) + abs (I[x+1][y]-I[x][y+1])

0 0 0

0 0

0 0 -1

1

0 0 0

0 1

0 -1 0

0](https://image.slidesharecdn.com/visionettraitementdimages-190104074823/85/Vision-et-traitement-d-images-147-320.jpg)

![166

Attributs

LBPC1, C1[I] LBPC2, C2[I] LBPC3, C3[I]

LBPC1, C2[I] LBPC1, C3[I] LBPC2, C1[I] LBPC3, C1[I]LBPC2, C3[I] LBPC3, C2[I]

• Motifs locaux binaires

• Pour caractériser la texture complète à analyser :

• Les LBP de chaque pixel de l’image I sont calculés,

• Les distributions correspondant aux 9 LBP sont présentées dans 9

histogrammes différents](https://image.slidesharecdn.com/visionettraitementdimages-190104074823/85/Vision-et-traitement-d-images-166-320.jpg)

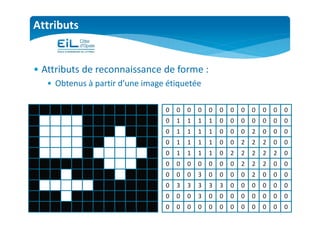

![185

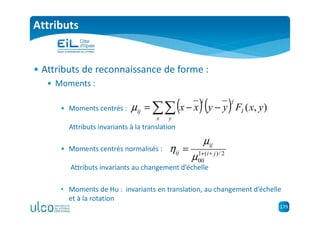

Attributs

• Attributs de reconnaissance de forme :

• Cavités :

• Calcul des attributs :

• Vecteurs d’attributs :

OuestEstSudNordCentre Σ+Σ+Σ+Σ+Σ

Σ

= θ

θ%

[ ]CentreNordSudOuestEstV θθθθθ=](https://image.slidesharecdn.com/visionettraitementdimages-190104074823/85/Vision-et-traitement-d-images-185-320.jpg)