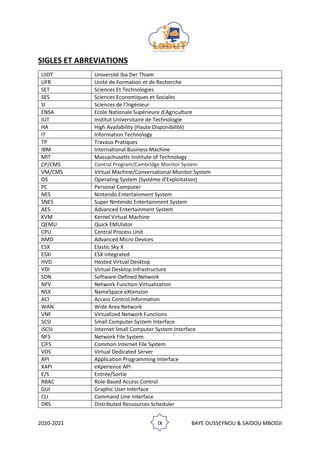

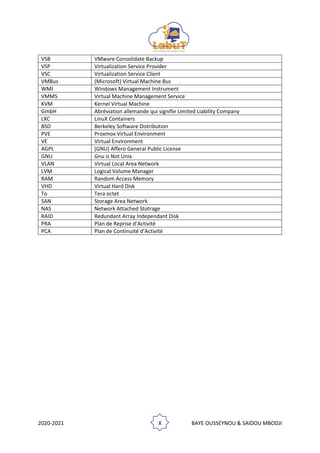

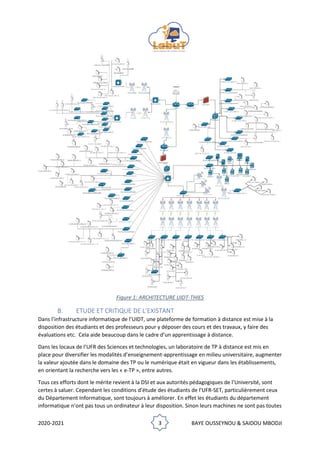

Le projet vise à établir un environnement virtuel hautement disponible à l'Université Iba Der Thiam de Thiès, en mettant l'accent sur la virtualisation avec Proxmox. Le rapport couvre la présentation de l'organisme d'accueil, une étude comparativa des solutions de virtualisation, et la mise en place de la solution choisie. L'objectif est de faciliter l'apprentissage des étudiants en offrant des ressources informatiques performantes adaptées à leurs besoins.