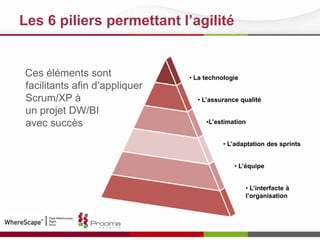

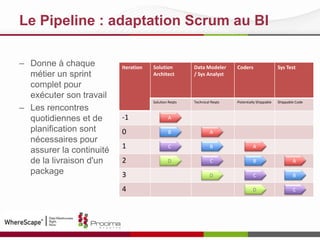

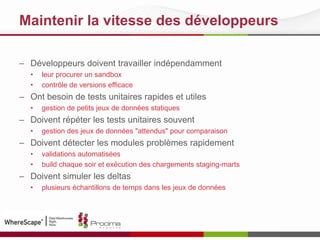

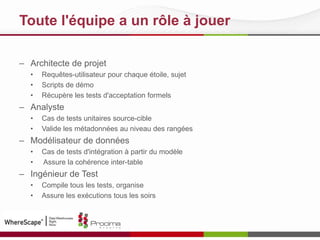

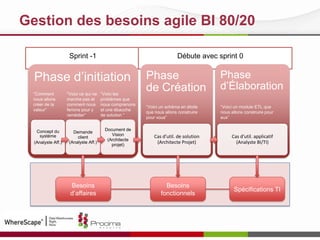

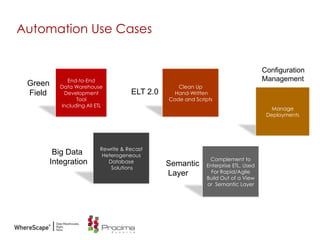

Le document aborde l'agilité appliquée aux projets de warehousing et business intelligence (BI), en définissant six piliers essentiels tels que l'équipe, l'adaptation des sprints et l'assurance qualité, pour réussir l'implémentation de méthodologies agiles comme Scrum. Il présente également Wherescape comme un acteur majeur dans l'automatisation des processus de développement et de gestion des entrepôts de données, mettant en avant des produits comme Red et 3D. Enfin, le document souligne les avantages de cette approche, notamment des résultats plus rapides, moins coûteux et de meilleure qualité pour les entreprises clientes.