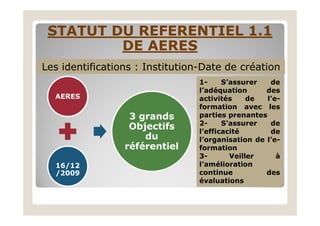

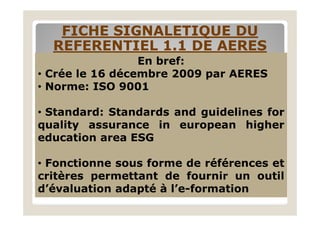

Le document traite de l'e-qualité en formation à distance en présentant des référentiels et des modèles d'évaluation, avec un focus sur l'approche AERES. Une étude spécifique analyse le parcours des apprenants et les normes qualité en vigueur. Il propose également un modèle d'évaluation développé par l'Ordre public pour la pédagogie de projet, soulignant les avantages et inconvénients de cette démarche.