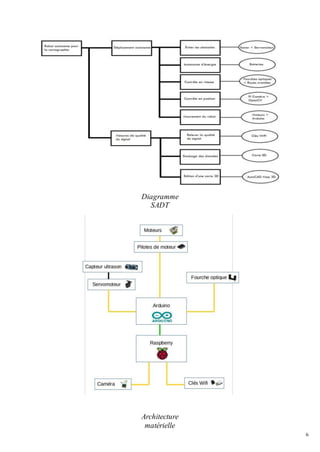

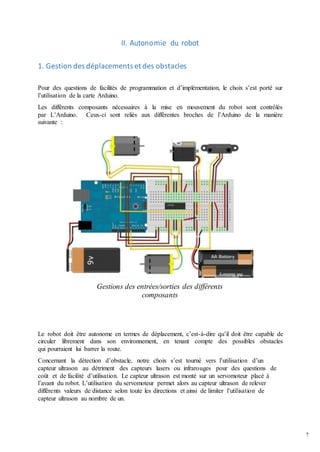

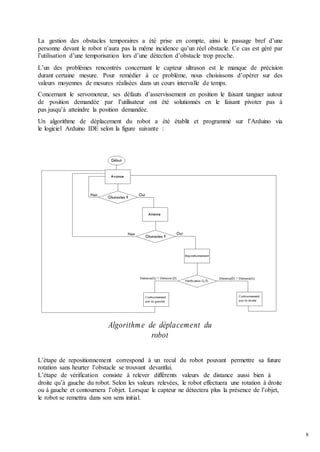

Le projet présente le développement d'un robot autonome destiné à la cartographie d'environnements électromagnétiques, en se basant sur la qualité des signaux Wi-Fi. Ce robot intègre une série de techniques pour assurer son autonomie, notamment dans ses déplacements, obstacles, et mesures de signal, tout en utilisant des technologies comme la Raspberry Pi et Arduino pour son contrôle. Malgré des limites et des difficultés rencontrées, le projet offre une expérience enrichissante en matière de travail en équipe et de gestion de projet.