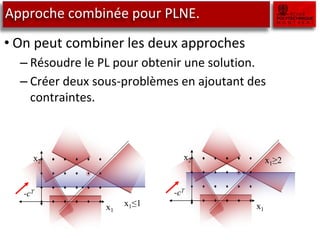

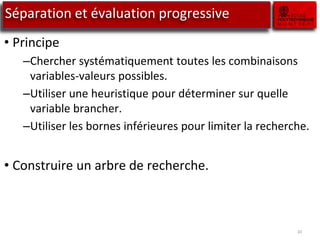

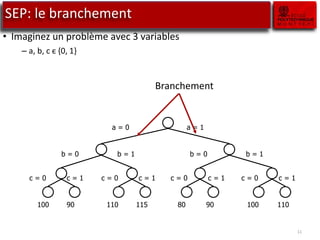

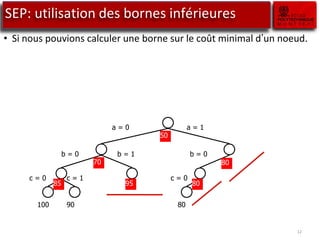

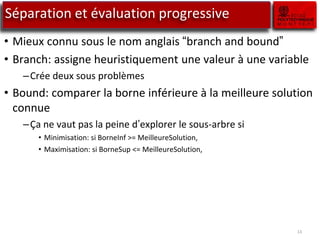

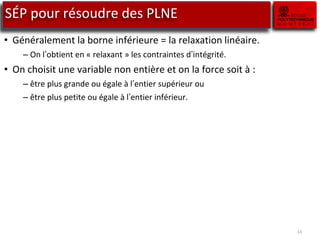

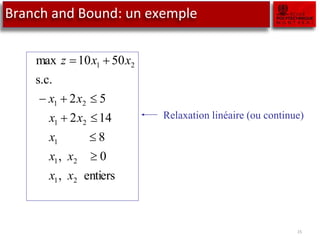

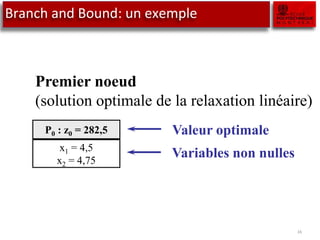

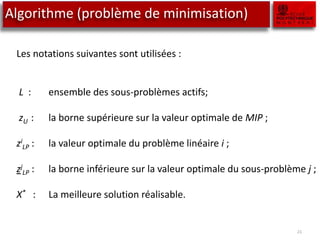

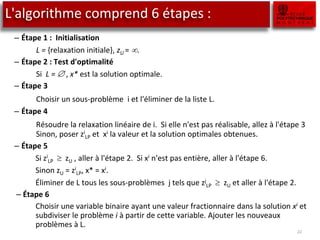

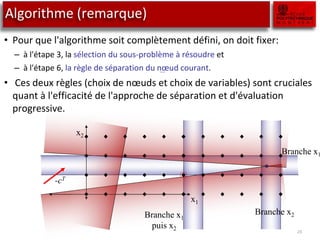

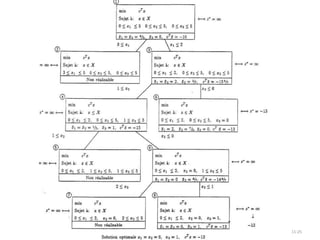

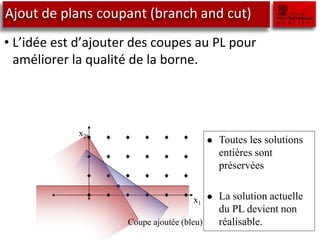

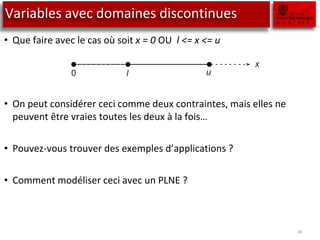

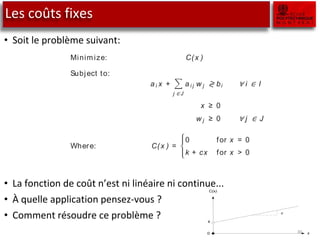

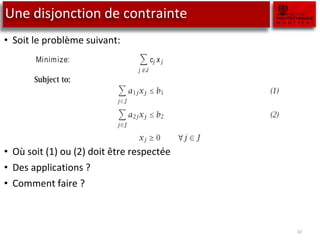

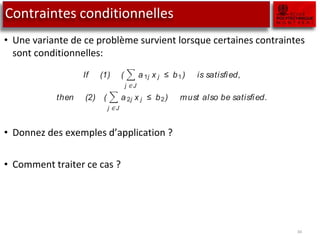

Le document traite des outils de recherche opérationnelle, en particulier sur la programmation en nombre entier (PLNE) et les méthodes de résolution telles que le simplexe et le branch and bound. Il explique comment ces méthodes sont appliquées pour résoudre des problèmes d'optimisation en utilisant des techniques telles que la relaxation linéaire et les sous-problèmes. Des astuces de modélisation pour des cas complexes, tels que les coûts fixes et les contraintes conditionnelles, sont également abordées.

![Les SOS (Special Ordered Sets)

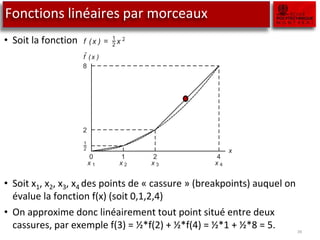

• Considérer le cas particulier suivant:

– Votre modèle comporte une série de décision oui/non ordonnée.

– Seulement une décision « oui » est possible

– Entre deux décisions « oui » on préfèrera toujours celle qui est la première dans la

série.

• Pour ce cela, on dispose généralement d’une série de variables booléennes

yi telles que

• On peut généraliser ce cas à :

– Aux variables générales xi tel que 0 <= xi <= u et sujet à

• On peut aussi considérer le cas où deux décisions « oui » sont permises,

mais elles doivent être consécutives.

• Les solveurs ont des objets de modélisation SOS1 et SOS2 qui implémentent

ces conditions de manières plus efficaces lors du branch and bound.

37

solvers. Two of them are treated in this section, and are re

cial Ordered Sets (SOS) of type 1 and 2. These concepts are

Tomlin ([Be69]).

SOS1

constraints

A common restriction is that out of a set of yes-no decisi

decision variable can be yes. You can model this as follow

zero-one variables, then

i

y i ≤ 1

forms an example of a SOS1 constraint. More generally, w

variables 0 ≤ x i ≤ u i , then the constraint

i

ai x i ≤ b

can also become a SOS1 constraint by adding the requirem

one of the x i can be nonzero. In Aimms there is a constrain

P

ropert yin which you can indicate whether this constraint is a

Note that in the general case, the variables are no longer rest

one variables.

lar types of restrictions in integer programming formulations

ommon, and that can be treated in an efficient manner by

them are treated in this section, and are referred to as Spe-

(SOS) of type 1 and 2. These concepts are due to Beale and

iction is that out of a set of yes-no decisions, at most one

can be yes. You can model this as follows. Let y i denote

es, then

i

y i ≤ 1

le of a SOS1 constraint. More generally, when considering

≤ u i , then the constraint

i

ai x i ≤ b

a SOS1 constraint by adding the requirement that at most

n be nonzero. In Aimms there is a constraint attribute named

you can indicate whether this constraint is a SOS1 constraint.

general case, the variables are no longer restricted to be zero-](https://image.slidesharecdn.com/plne-230428011349-67330c2f/85/PLNE-pptx-32-320.jpg)

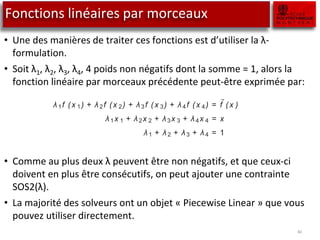

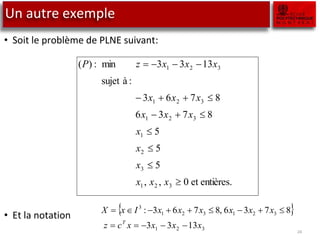

![Fonctions linéaires par morceaux

• Soit le problème suivant:

• Ici on remarque que l’objective, bien que non linéaire, est séparable.

• C’est-à-dire que l’objectif est une somme de fonctions définies sur

une variable à la fois.

Séparable Non séparable

38

7.6 Piecewise linear formulations

Consider the following model with a separable objective function:

Minimize:

j ∈ J

f j (x j )

Subject to:

j ∈ J

ai j x j ≷ bi ∀ i ∈ I

x j ≥ 0 ∀ j ∈ J

In the above general model statement, the objective is a separable function,

which is defi ned as the sum of functions of scalar variables. Such a func-

tion has the advantage that nonlinear terms can be approximated by piecewise

linear ones. Using this technique, it may be possible to generate an integer pro-

gramming model, or sometimes even a linear programming model (see [Wi90]).

This possibility also exists when a constraint is separable.

Some examples of separable functions are:

x 2

1 + 1/ x 2 − 2x 3 = f 1(x 1) + f 2(x 2) + f 3(x 3)

x 2

1 + 5x 1 − x 2 = g1(x 1) + g2(x 2)

The model

llowing model with a separable objective function:

j ∈ J

f j (x j )

j ∈ J

ai j x j ≷ bi ∀ i ∈ I

x j ≥ 0 ∀ j ∈ J

Separ able

function

eneral model statement, the objective is a separable function,

ed as the sum of functions of scalar variables. Such a func-

vantage that nonlinear terms can be approximated by piecewise

ng this technique, it may be possible to generate an integer pro-

el, or sometimes even a linear programming model (see [Wi90]).

also exists when a constraint is separable.

Examples of

separable

functions

of separable functions are:

x 2

1 + 1/ x 2 − 2x 3 = f 1(x 1) + f 2(x 2) + f 3(x 3)

x 2

1 + 5x 1 − x 2 = g1(x 1) + g2(x 2)

84 Chapter 7. Integer Linear Programming Tricks

The following examples are not:

x 1x 2 + 3x 2 + x 2

2 = f 1(x 1, x 2) + f 2(x 2)

1/ (x 1 + x 2) + x 3 = g1(x 1, x 2) + g2(x 3)

Approximation Consider a simple example with only one nonlinear term to b](https://image.slidesharecdn.com/plne-230428011349-67330c2f/85/PLNE-pptx-33-320.jpg)