Le document présente une synthèse des ateliers de 2017 sur l'évolution des entreprises vers un modèle data-driven, soulignant l'importance de l'utilisation de la data pour améliorer l'expérience client. Il aborde les défis liés à la gestion des données à travers les silos organisationnels et insiste sur la nécessité de personnaliser les interactions clients pour répondre à leurs attentes croissantes. La synthèse se base sur des témoignages d'experts et de praticiens partageant leurs retours d'expérience autour de projets big data.

![53

de données. Ces data très étendues

permettront de rechercher des signaux

complémentaires afin d’enrichir la

connaissance client.

L’univers est totalement fragmenté, avec

une multitude de devices, de systèmes

d’exploitation, etc. Il convient donc de

réconcilier l’utilisateur sous son identité

unique. La maturité montre qu’on se dirige

de plus en plus vers un marketing des

segments, un marketing des audiences.

La DMP a l‘ambition de réunir des données

issues de sources variées pour les mettre

en cohérence. »

RÉUNIR AUTOUR DE

LA TABLE TOUTES LES

PARTIES PRENANTES

Dès lors que l’on veut adjoindre au

marketing programmatique les ressources

du big data, la première difficulté consiste

à faire converger les enjeux. Car, « si vous

faites le compte des acteurs impliqués dans

une campagne , observe Samboy Camara

(fifty-five), on descend très rarement sous

la barre des cinq interlocuteurs ! Or,

aujourd’hui, la notion de temps réel devient

une obligation. Le programmatique a

justement vocation à simplifier la phase de

gestion des campagnes. L’automatisation

permet de gagner du temps pour éviter les

points bloquants. Cela implique toutefois

un réajustement organisationnel pour

passer d’une approche patrimoniale de

la donnée (data = stock) à une vision en

termes de circulation (data = flux).»

Fiona Ongaro (La Fourchette) confie ainsi

avoir « recruté quelqu'un qui fait avant tout

figure d’électron libre, c’est-à-dire qu’il n’est

pas rattaché à un pôle Métier en particulier »

mais reconnaît : « Nous avons encore du

mal à identifier la bonne organisation. »

Pour Kamal Mouhcine (Turn), il est important

de créer ce rôle transverse notamment pour

démontrer la valeur ajoutée des plateformes

data pouvant préfigurer de l'automatisation.

« Pour les organisations qui ont une taille

critique, la DMP présente un réel intérêt.

Encore faut-il parvenir à démontrer cet

intérêt, d’où l’importance du rôle dévolu au

CDO. Lors de la mise en place d’une DMP,

il convient de commencer par démontrer

des choses très simples. »

Ce travail de démonstration est essentiel,

d'autant qu'au final, « comme avec des

tels projets [data], le ROI à court terme est

difficilement lisible, il est bien difficile de

prioriser » (Fiona Ongaro, La Fourchette).

En retour, le big data est une opportunité

d'ancrer dans l'opérationnel un réajustement

organisationnel. Julien Cafede témoigne

ainsi du cas d'Auchan. « Notre DMP nous

permet notamment de créer et utiliser

des segments des données dynamiques

que nous pouvons ensuite plugger à nos

plateformes partenaires. Aujourd’hui,

les entités e-commerce, Drive, Direct,

Proximité, etc. ont été regroupées sous

une nouvelle entité : Auchan Retail ; il

s’agit désormais de les faire communiquer

plus étroitement et le big data semble être

une bonne clé d’entrée. »

« L’automatisation permet de gagner du temps pour éviter les

points bloquants. »

Samboy Camara, fifty-five](https://image.slidesharecdn.com/ebglivretdesynthse2017-170616092911/85/EBG-Livret-de-synthese-2017-55-320.jpg)

![64

y a dix-huit ou vingt-quatre mois environ,

nous avons clairement ressenti le besoin

de monter en compétences sur la partie

big data, de par la nécessité de nous

rapprocher des besoins métiers du pôle

Commercial. »

Pierre-Yves Hémon, (Barclays Pank Plc),

résume en ces termes. « Justement, la

mission du data scientist ne se rapporte

pas exclusivement à la technique… Il doit

être en mesure de réaliser le trait d’union

entre deux mondes : c’est un marketeur qui

sait faire des statistiques. »

TROUVER LES BONS

PROFILS…

Beaucoup partagent le constat de Francine

Quentel (Air France KLM). « Il s’avère difficile

de recruter ces profils » doté d’une double

sensibilité.

Pour Aurélie Rossignol (Boursorama), un

gisement de talents existe déjà dans les

entreprises. « Selon moi, le data scientist

détient une brique technique plus avancée

que le data miner. Il est possible de faire

montercedernierencompétences,puisque

la data science est un prolongement du

data mining. Les racines sont communes. »

D’où que les talents proviennent, il s’agit

de les alimenter au long cours en missions

intéressantes et de les doter des outils pour

le faire. Chez M6, témoigne Karim Louedec,

« le data lake est là pour que les data

scientists puissent s’exprimer pleinement.

LE DATA SCIENTIST, UN

STATISTICIEN QUI S’EST

MIS À LA DATA ?

Christelle Jason (PMU) pose la question.

« Data scientist, est-ce réellement un

nouveau métier ? Un data scientist n’est-

il pas simplement un statisticien qui se

serait fait uberisé ? Au-delà de la richesse

technique, la nouveauté ne saute pas aux

yeux… »

Selon Clément Carrier (Caisse des Dépôts),

« un data scientist est une personne qui

a une formation de type ingénieur en

mathématiques ou en informatique. Un

data miner a, quant à lui, bénéficié d’une

formation moins scientifique. Afin de

passer du data mining à la data science, il

convient d’avoir un bagage mathématique

suffisant.

Mon objectif, c’est que le métier exprime

clairement ses problématiques. Ensuite, il

s’agit pour nous de voir si on peut répondre

à ces besoins grâce à la manipulation de la

donnée. Il nous faut donc être proches des

métiers, mais aussi proches de l’IT. »

Ainsi, chez Air France KLM, le département

IMO Sales, Data BI, « positionné côté

métiers », « intègre dorénavant des

data scientists dans [ses] équipes. » Sa

directrice Francine Quentel s’en explique.

« Jusqu’à il y a peu, nous n’avions besoin

que de business analysts situés sur de la

donnée classique, ou structurée. Puis, il](https://image.slidesharecdn.com/ebglivretdesynthse2017-170616092911/85/EBG-Livret-de-synthese-2017-66-320.jpg)

![67

Enfin, si data scientists et utilisateurs

métiers doivent avancer ensemble, il

convient qu’ils soient alignés sur les bons

KPIs. « Tout passe par les KPIs, juge Karim

Louedec (M6), qui permettent de valider ou

non le fait que le modèle choisi soit bon.

Les data scientists partent du principe que

ce qui s’est fait dans le passé arrivera de

nouveau dans le futur. Par exemple, sur le

module de recommandation, avant même

de lancer le projet, nous tenons à définir

clairement les KPIs que nous suivrons et

qui détermineront la réussite du projet. »

EMBARQUER LE MÉTIER

Les data scientists ont certes besoin de

s’exprimer. Il ne s’agirait pas d’oublier,

pour reprendre les termes de Christelle

Jason (PMU), de « [prendre] en compte la

question de la montée en compétences

des métiers ».

Chez Boursorama aussi, « au quotidien,

l’enjeu consiste également à embarquer

les métiers sur les sujets data. »

Karim Louedec (M6) partage une piste.

« Pour le moment, le data lake et les data

scientists ont pour ambition principale

de montrer la donnée aux métiers. Nous

réunissons sur la plateforme 6Play environ

14 millions d’inscrits. Qui sont-ils ?

Comment les faire revenir un peu plus

souvent ? La première étape consiste donc

à mettre à disposition des dashboards. »

Benoît Rigaut (Chanel) observe lui aussi

que « la capacité à prendre des décisions

orientées sur la data est devenu un enjeu

majeur. Il s’agit d’unlocker la data par la

data visualisation. Aujourd’hui, les outils

avancés de data visualisation permettent

d’aller bien plus loin qu’un dashboard

classique. »

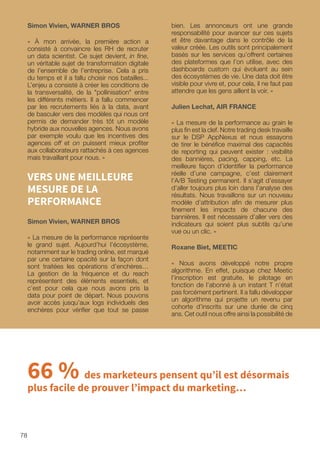

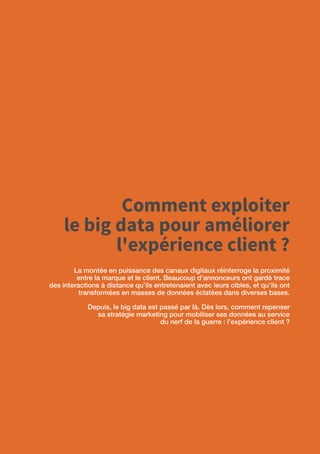

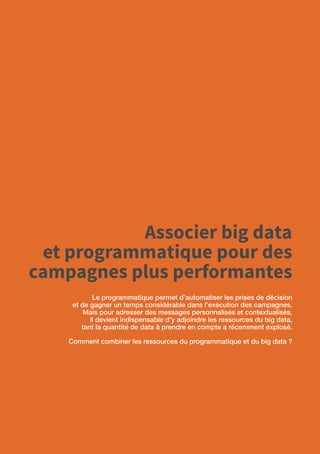

QUELLES COMPÉTENCES MANQUENT LE PLUS DANS VOTRE ENTREPRISE

POUR MENER À BIEN VOS PROJETS LIÉS À LA DATA ? (Plusieurs réponses possibles)

SPÉCIALISTE DATA MANAGEMENT

SPÉCIALISTE DATA SCIENCE

SPÉCIALISTE BIG DATA

SPÉCIALISTE DATA VISUALIZATION

38 %

34 %

31 %

26 %](https://image.slidesharecdn.com/ebglivretdesynthse2017-170616092911/85/EBG-Livret-de-synthese-2017-69-320.jpg)