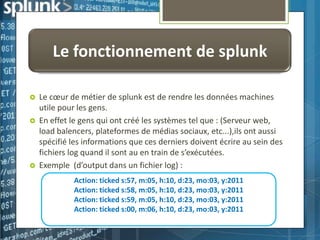

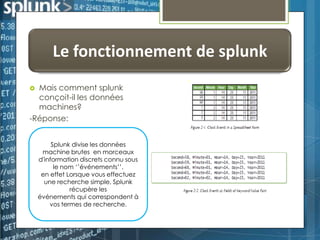

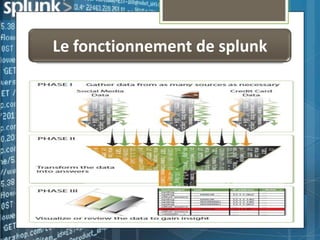

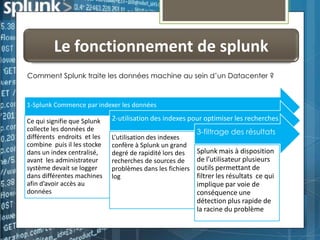

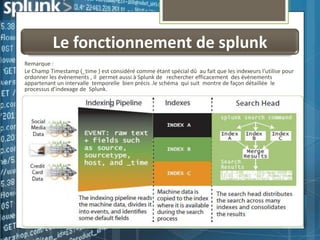

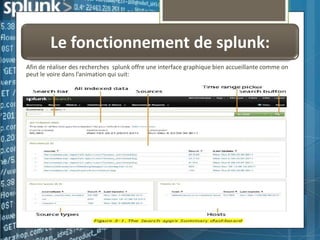

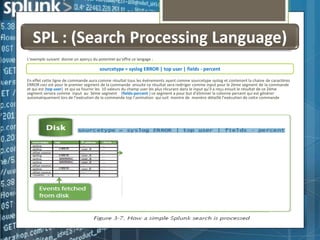

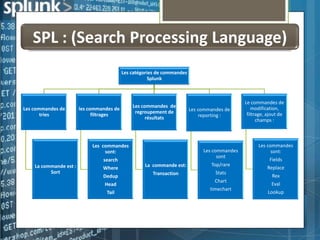

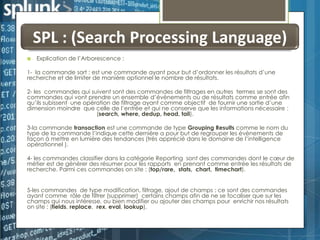

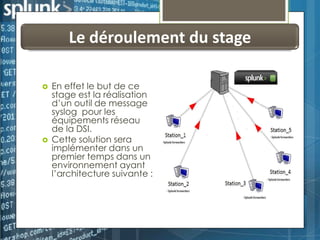

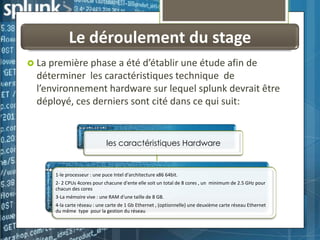

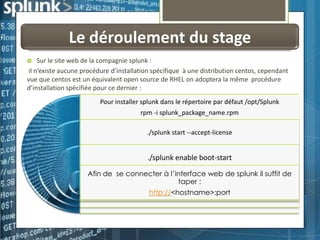

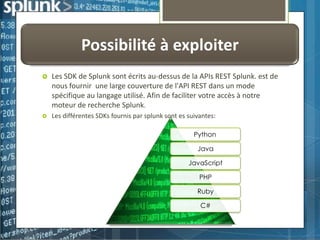

Cette présentation sur Splunk, réalisée par M. Ihsine Najib, souligne son importance en tant que plateforme d'analyse des données machine, offrant des solutions dans divers contextes, tels que les centres de données et le marketing. Elle explique le fonctionnement de Splunk, notamment le traitement et l'indexation des données, ainsi que l'utilisation de son langage de traitement de recherche, le SPL, pour réaliser des recherches précises. Enfin, le document aborde les possibilités d'intégration via des SDK, facilitant ainsi l'exploitation des données de Splunk dans diverses applications.