Ce document présente un examen sur les séries chronologiques, abordant des processus AR, MA, et ARMA à travers des équations et des exercices. Chaque exercice implique des calculs sur les autocorrélations et des relations entre différentes séries temporelles, aboutissant à des conclusions concernant la stationnarité et les propriétés des modèles. Les résultats sont soutenus par des simulations et des démonstrations mathématiques.

![2 ARTHUR CHARPENTIER

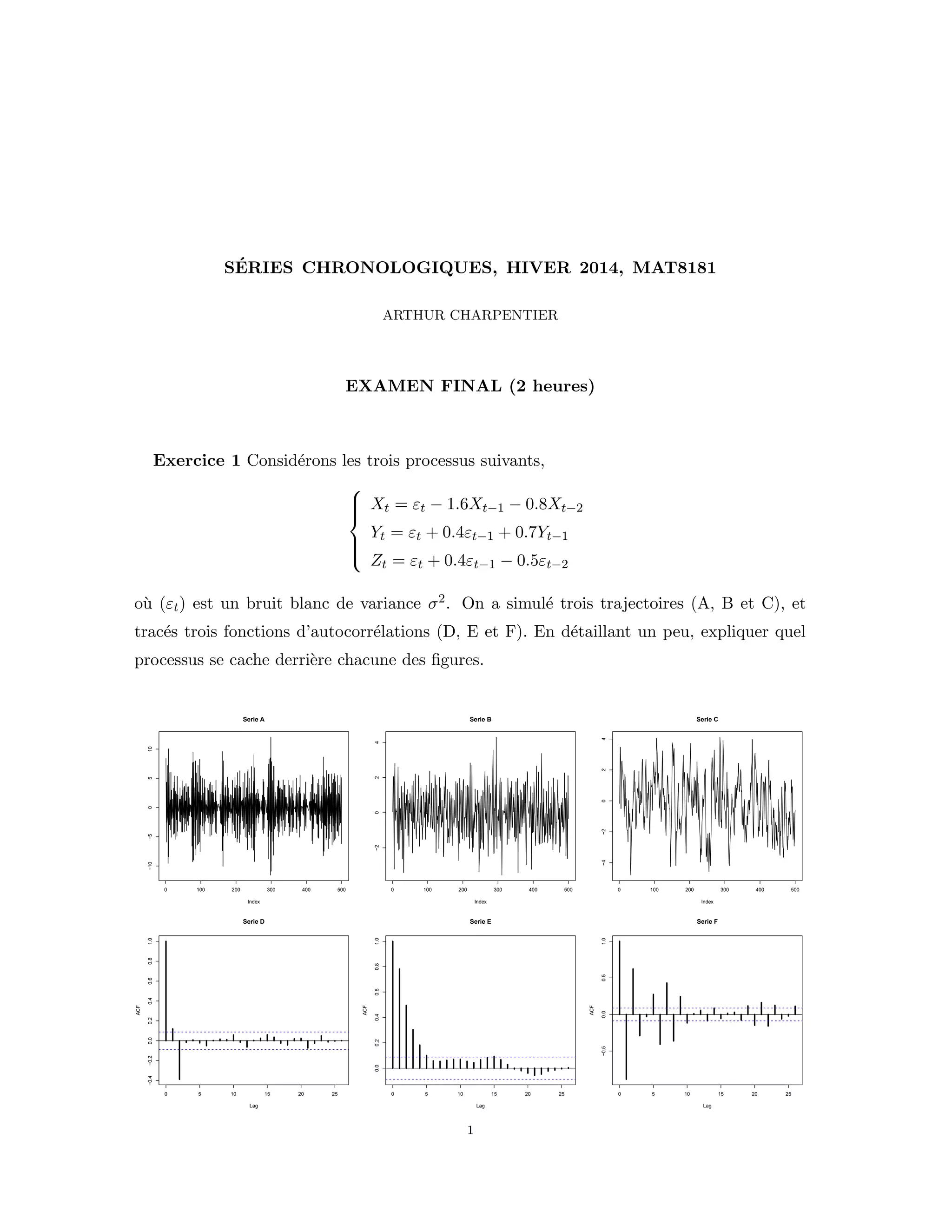

Commen¸cons par le plus simple: les autocorr´elogrammes. On doit retrouver un AR(2) -

s´erie X - un ARMA(1,1) - s´erie Y - et un MA(2) - s´erie Z. Le premier autocorr´elogramme est

celui d’un MA(2), c’est donc Z. Le troisi`eme pr´esente des autocorr´elations qui changent de

signe, alors qu’avec le second, on a juste une d´ecroissance exponentielle. Pour rappel, avec

un ARMA(1,1), la premi`ere autocorr´elation n’est pas comme pour un AR(1), i.e. ρ(1) = φ

(il faut tenir compte de θ), mais ensuite, on retrouve ρ(h) = φ · ρ(h − 1), avec ici φ = 0.7.

Aussi, la s´erie Y correspond `a un autocorr´elogramme du type E. Pour la s´erie X, il faut

noter qu’on est dans partie inf´erieure du triangle de stationnarit´e (pour le couple (φ1, φ2).

En fait, on a ici

(1 + 1.6L + 0.8L2

)Xt = εt

dont les racines sont ici complexes (en fait les racines sont (−2 ± i)/2), aussi ρ(h) sera une

fonction sinuso¨ıdale, qui va donc changer de signe. C’est donc bien l’autocorr´elogramme

qui reste, F.

La premi`ere s´erie, repr´esent´ee en A pr´eseente des alternances, correspondant `a l’autocor-

r´elogramme F. C’est donc le processus AR(2), X. La troisi`eme s´erie a une variance beaucoup

plus grande que la seconde, avec davantage d’autocorr´elation. La s´erie C fait penser `a un

AR(1), mais comme on n’en a pas, ¸ca sera le processus ARMA(1,1), Y . Et B est une s´erie

plus proche d’un bruit, c’est donc la s´erie MA(2), Z.

Exercice 2

Soient εt et (ηt) deux bruits blancs, et θ ∈ (−1, 0) ∪ (0, 1). Montrer que les s´eries

Xt = εt + θεt−1 et Yt = ηt +

1

θ

ηt−1

ont les mˆemes fonctions d’autocorr´elation.

Dans les deux cas, on a MA(1), autrement dit, ρX(h) = ρY (h) = 0 pour |h| > 1. Reste `a

v´erifier que ρX(1) = ρY (1). On se lance, en notant que les processus sont cent´es, autrement

dit

ρX(1) =

cov(Xt, Xt−1)

var(Xt)

=

E(XtXt−1)

E(X2

t )

Calculons les deux termes,

E(X2

t ) = E([εt + θεt−1]2

)](https://image.slidesharecdn.com/ts-exam-h2014-correction-160605180142/85/Ts-exam-h2014-correction-2-320.jpg)

![S´ERIES CHRONOLOGIQUES, HIVER 2014, MAT8595 3

soit

[1 + θ2

]E(ε2

t ) + 2θ E(εtεt − 1)

=0

alors que pour le num´erateur,

E(XtXt−1) = E([εt + θεt−1][εt−1 + θεt−2])

soit (un seul terme sera non nul, je passe les d´etails)

θE(ε2

t−1)

Bref, le ratio est ici

ρX(1) =

E(XtXt−1)

E(X2

t )

=

θ

1 + θ2

(en notant que le terme de variance du bruit disparaˆıt). Pour l’autre s´erie, le calcul sera

identique, avec θ−1 au lieu de θ. Aussi,

ρY (1) =

E(YtYt−1)

E(Y 2

t )

=

θ−1

1 + θ−2

= ρX(1)

ce qui donne, en multipliant en haut et en bas par θ2,

ρY (1) ==

θ

θ2 + 1

Autrement dit, les deux fonctions co¨ıncident effectivement.

Exercice 3 Soit (εt) un bruit blanc (faible) et (Xt) un processus stationnaire au second

ordre, v´erifiant la relation de r´ecurence

Xt = −0.4 Xt−1 + 0.12 Xt−2 + εt.

(1) de quel mod`ele ARMA s’agit-il ?

(2) montrer que (εt) est l’innovation de (Xt), et que la fonction d’autocovariance de (Xt),

not´ee ρ(·), v´erifie une relation de r´ecurrence de la forme

ρ(h) = aρ(h − 1) + bρ(h − 2), pour h ≥ 2,

o`u a et b sont des constantes `a pr´eciser.

(3) donnez la variance de (εt) pour que la variance de (Xt) sont unitaire.](https://image.slidesharecdn.com/ts-exam-h2014-correction-160605180142/85/Ts-exam-h2014-correction-3-320.jpg)

![4 ARTHUR CHARPENTIER

(4) montrer que

ρ(h) =

2

11

[0.2]h

+

9

11

[−0.6]h

pour tout h ≥ 0.

(1) C’est un AR(2), ou ARMA(2,0).

(2) Dans un processus AR(p), le bruit est le processus d’innovation d`es lors que la racines

du polynˆome retard sont `a l’ext´erieur du disque unit´e. Or ici le polynˆome est

Φ(L) = (1 + 0.4L − .12L2

) = (1 + 0.6L)(1 − 0.2L)

dont les racines sont −1/0.6 et 1/0.2, qui sont plus grandes que 1 (en valeur absolue).

Pour les autocorr´elations, soit h ≥ 2. Notons que le processus est centr´e. Aussi, en

notant γ la fonction d’autocovariance, γ(h) = E(XtXt−h)

ρ(h) =

γ(h)

γ(0)

Maintenant, si on multiplie l’´equation de r´ecurence par Xt−h,

XtXt−h = −0.4 Xt−1Xt−h + 0.12 Xt−2Xt−h + εtXt−h.

or comme (εt) est le processus d’innovation, E(εtXt−h) = 0. Et donc, en prenant l’esp´erance

des termes de l’´equation pr´ec´edante, on a

γ(h) = −0.4γ(h − 1) + 0.12γ(h − 2), pour h ≥ 2.

soit, en divisant par γ(0),

ρ(h) = −0.4ρ(h − 1) + 0.12ρ(h − 2), pour h ≥ 2.

(3) On s’´etait limit´e au cas h ≥ 2 dans la question pr´ec´edante. Regardons h = 1, en

multipliant la relation de r´ecurence par Xt−1,

XtXt−1 = −0.4 Xt−1Xt−1 + 0.12 Xt−2Xt−1 + εtXt−1.

Si on prend l’esp´erance, le terme de droite va disparaˆıtre (comme auparavant) et on obtient

γ(1) = −0.4γ(0) + 0.12γ(1)

de telle sorte que

ρ(1) =

−0.4

1 − 0.12

=

−5

11

.](https://image.slidesharecdn.com/ts-exam-h2014-correction-160605180142/85/Ts-exam-h2014-correction-4-320.jpg)

![S´ERIES CHRONOLOGIQUES, HIVER 2014, MAT8595 5

Maintenant, pour calculer la variance de Xt, notons que

E(X2

t ) = E([−0.4 Xt−1 + 0.12 Xt−2 + εt]2

)

On va alors d´evelopper le terme de droite. On va passer les d´etails, mais on se souvient que

(εt) est le processus d’innovation, et donc il est orthogonal au pass´e de Xt. Aussi,

E(X2

t ) = [0.42

+ 0.122

]E(X2

t ) − 0.4 · 0.12E(XtXt−1) + 0 + E(ε2

t )

avec E(XtXt−1) = γ(1) = ρ(1)E(X2

t ), avec ρ(1) que l’on vient de calculer. Aussi, la variance

de Xt v´erifie

[1 − [0.42

+ 0.122

] − 0.4 · 0.12 ·

−5

11

]var(Xt) = var(εt).

soit (pour utiliser une formule qu’on peut retrouver dans des cours sur les AR(2))

var(Xt) =

1 − 0.12

1 + 0.12

1

(1 − 0.12)2 − 0.42

var(εt).

Peu importe la valeur num´erique, je donne les points pour ceux qui ont not´e qu’on pouvait

effectivement extraire la variance du processus dans le cas d’un AR(2).

(4) On sait que la solution g´en´erale de la suite d´efinie par r´ecurence,

ρ(h) = −0.4ρ(h − 1) + 0.12ρ(h − 2), pour h ≥ 2

est de la forme

ρ(h) = Arh

1 + Brh

2 , pour h ≥ 0

o`u r1 et r2 sont les racines distinctes du polynˆome charact´eristique. Or on a calcul´e les

racines du-dit polynˆome dans la question (2). Aussi,

ρ(h) = A[0.2]h

+ B[−0.6]h

, pour h ≥ 0

On obtient les valeurs de A et B avec les premi`eres valeurs, ρ(0) = 1 = A + B et ρ(1) =

−5/11 = 0.2A−0.6B. On a ainsi un syst`eme (lin´eaire) `a r´esoudre.... Je passe ici les d´etails,

mais on peut v´erifier rapidement que la solution propos´ee est la seule qui marche.

Exercice 4

(1) Soit M la matrice 2 × 2

M =

a b

d c](https://image.slidesharecdn.com/ts-exam-h2014-correction-160605180142/85/Ts-exam-h2014-correction-5-320.jpg)

![S´ERIES CHRONOLOGIQUES, HIVER 2014, MAT8595 7

avec Ut = (1 − γL)ut − βLvt. Pour la partie de gauche, on peut r´e´ecrire

(1 − [γ + α]L + [αγ − βδ]L2

)Xt = Ut

Autrement dit, si αγ = βδ, on a un polynˆome autor´egressif de degr´e 2. Pour la partie de

droite, on va montrer que (Ut) est un processus MA(1). En effet

γu(1) = E(UtUt−1) = E([ut − γut−1 − βvt−1] · [ut−1 − γut−2 − βvt−2]) = −γ

qui sera non nul si γ = 0. Si on regarde pour les retards plus ´elev´es, pour h > 1,

γu(h) = E(UtUt−1) = E([ut − γut−1 − βvt−1] · [ut−h − γut−h−1 − βvt−h−1]) = 0.

On obtient ainsi un MA(1). Autrement dit, il existe θ et un bruit blanc (εt) tel que

(1 − [γ + α]L + [αγ − βδ]L2

)Xt = (1 + θL)εt

Autrement dit, si αγ = βδ et γ = 0, (Xt) est un ARMA(2,1). Et de mani`ere symm´etrique,

si αγ = βδ et α = 0, (Yt) est un ARMA(2,1).

Exercice 5

Soit (ηt) une suite de variables i.i.d. de loi N(0, 1), et k ∈ N . On pose

εt = ηt · ηt−1 · · · ηt−k.

(1) Montrer que (εt) est un bruit blanc faible, mais pas un bruit blanc fort.

(2) Montrer que (ε2

t ) suit un MA(k).

(1) Commen¸cons avec l’histoire du bruit blanc faible. Notons d´ej`a que - comme toujours

- le processus est centr´e et donc γ(h) = E(εtεt−h). Aussi

E(εtεt−h) = E([ηt · ηt−1 · · · ηt−k][ηt−h · ηt−h−1 · · · ηt−k−h])

On utilise ici le fait que les variables (ηt) sont toutes ind´epdantes, et en particulier ηt est

in´ependante de toutes les autres, si h = 0. Aussi,

E(εtεt−h) = E(ηt)

=0

·E([ηt−1 · · · ηt−k][ηt−h · ηt−h−1 · · · ηt−k−h]).

Bref, assez facilement, on a le fait que (εt) est un bruit blanc faible.](https://image.slidesharecdn.com/ts-exam-h2014-correction-160605180142/85/Ts-exam-h2014-correction-7-320.jpg)

![8 ARTHUR CHARPENTIER

Compte tenu de la question suivante, pour montrer que l’on n’a pas un bruit blanc fort,

on va montrer que cov(ε2

t , ε2

t−k) = 0. Pour cela, on ´ecrit

cov(ε2

t , ε2

t−k) = cov([ηt · ηt−1 · · · ηt−k]2

, [ηt−k · ηt−k−1 · · · ηt−2k]2

)

On utilise alors la ‘lin´earit´e’ de la covariance - au sens o`u

cov(aX + bY, Z) = acov(X, Z) + bcov(Y, Z)

de telle sorte que

cov(ε2

t , ε2

t−k) = cov(η2

t−k, η2

t−k) +

i=j

cov(η2

t−i, η2

t−j)

=0

(o`u le second terme veut juste dire qu’on a des covariances entre des composantes ind´epdantes).

Aussi,

cov(ε2

t , ε2

t−k) = var(η2

t−k) > 0.

Aussi, (εt) n’est pas un bruit blanc fort.

(2) On va gagner un peu de temps ici compte tenu des calculs qu’on vient des faire: en

effet, il suffit de montrer que cov(ε2

t , ε2

t−k−h) = 0 pour h ≥ 1 pour garantir que (ε2

t ) suit un

MA(k). Mais c’est trivial, puisque quand on d´eveloppe,

cov(ε2

t , ε2

t−k−h) =

i=j

cov(η2

t−i, η2

t−j)

=0

Aussi, on a prouv´e que

γε2 (k) = cov(ε2

t , ε2

t−k) = 0

γε2 (h) = cov(ε2

t , ε2

t−h) = 0 pour h > k

On reconnaˆıt ici une caract´eristique des processus MA(k).](https://image.slidesharecdn.com/ts-exam-h2014-correction-160605180142/85/Ts-exam-h2014-correction-8-320.jpg)