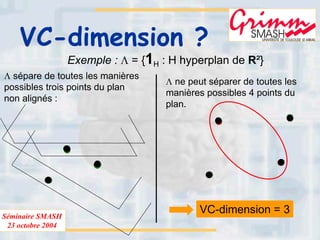

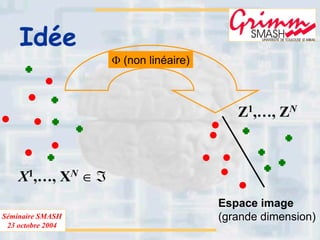

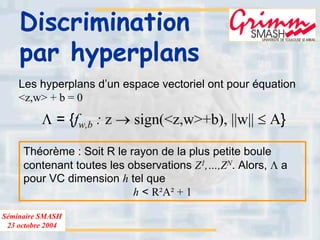

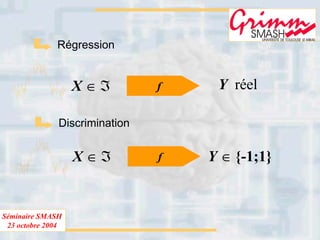

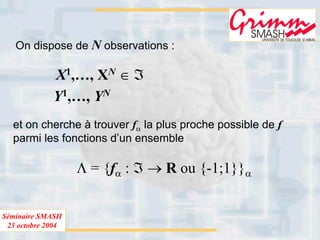

Ce document présente une introduction aux machines à vecteurs de support (SVM), abordant des aspects de la théorie de l'apprentissage et des techniques de classification. Il explore comment ces méthodes se basent sur des hyperplans pour la discrimination et met en lumière l'importance des noyaux pour travailler dans des espaces de haute dimension. Enfin, il discute des concepts de risque et de dimension VC liés aux SVM.

![Séminaire SMASH

23 octobre 2004

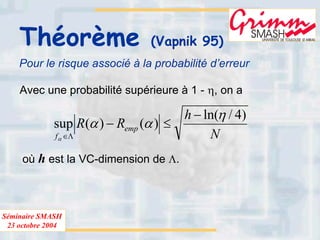

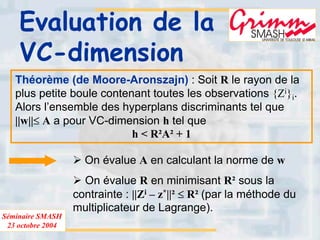

Le risque

Fonction de perte : L : R ×ℑ → [0;1]

exemples : L(y,fα(x)) = (y-fα(x))²

L(y,fα(x)) = 1{y = fα(x)}

Risque : R(α) = E (L(Y,fα(X)))

exemples : EQM

Probabilité d’erreur

Risque empirique : Remp(α) =

exemples : Erreur quadratique de prédiction

Nombre d’erreurs dans l’échantillon

∑=

N

i

ii

XfYL

N 1

))(,(

1](https://image.slidesharecdn.com/grimm2004-10-22-140831083655-phpapp02/85/Theorie-de-l-apprentissage-et-SVM-presentation-rapide-et-premieres-idees-dans-le-cadre-fonctionnel-6-320.jpg)