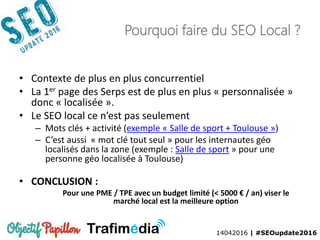

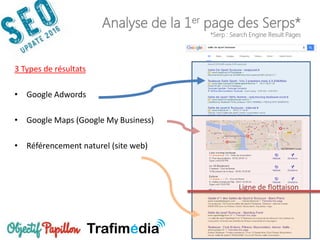

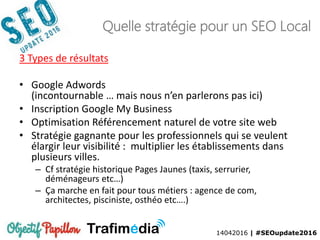

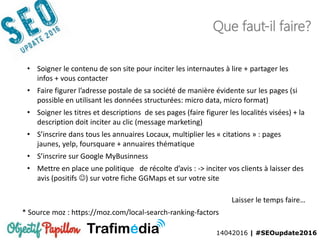

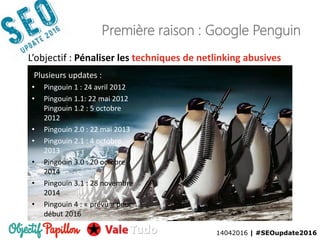

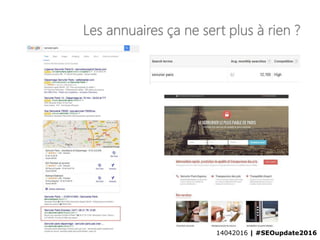

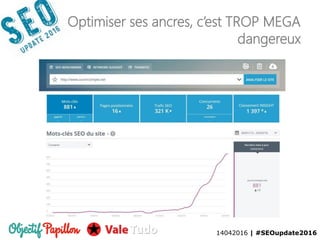

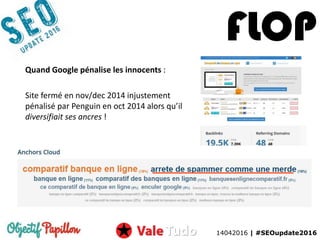

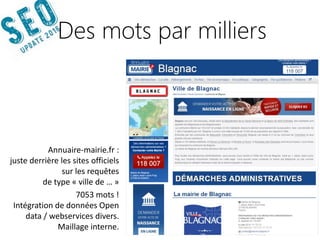

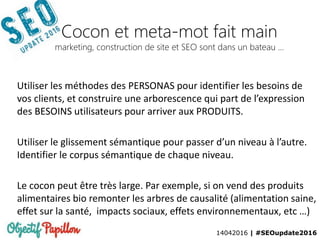

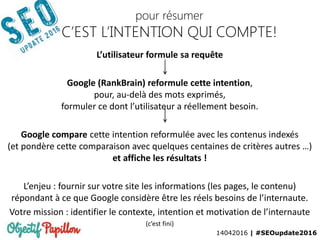

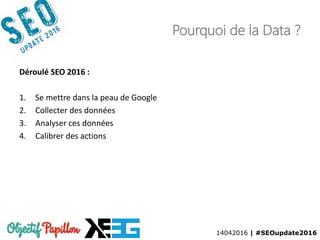

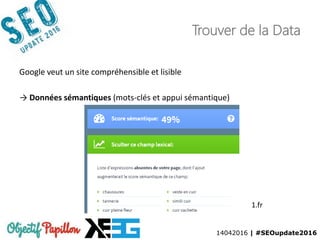

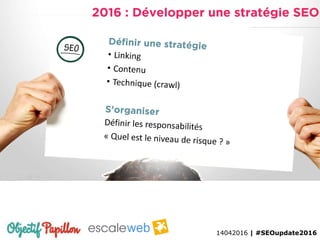

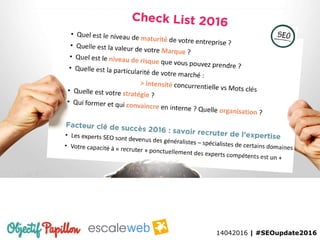

Le document traite des techniques et stratégies de référencement naturel, mettant l'accent sur le SEO local et l'importance de Google My Business. Il aborde également l'évolution du netlinking, en répondant aux préoccupations sur la pérennité de cette pratique face aux mises à jour algorithmiques de Google. Enfin, les concepts de sémantique et d'optimisation des contenus sont présentés comme cruciaux pour améliorer la visibilité en ligne.